Table of Contents

In WordPress ist es grundsätzlich kein Problem, wenn ein Beitrag drei Kategorien zugeordnet wird. Es handelt sich dabei nicht um Duplicate Content im klassischen Sinne, wie es Google und andere Suchmaschinen negativ bewerten würden.

Warum es KEIN Duplicate Content ist:

- Interne Struktur: Wenn du einem Beitrag mehrere Kategorien zuweist, wird der Beitrag nicht mehrfach auf deiner Website gespeichert oder veröffentlicht. Der Beitrag existiert weiterhin nur einmal in deiner WordPress-Datenbank.

- Archivseiten: Was passiert, ist, dass der Link zum Beitrag auf den Archivseiten der jeweiligen Kategorien angezeigt wird. Beispiel:

deine-domain.de/kategorie/kat1/(zeigt den Beitrag an)deine-domain.de/kategorie/kat2/(zeigt den Beitrag an)deine-domain.de/kategorie/kat3/(zeigt den Beitrag an) Aber der Beitrag selbst ist immer derselbe Original-Beitrag unter seiner permalink-URL (z.B.deine-domain.de/mein-beitrag-titel/).

- Google versteht das: Suchmaschinen wie Google sind sehr gut darin, die interne Struktur von Websites zu verstehen. Sie wissen, dass es sich hierbei um eine organisatorische Logik handelt und nicht um den Versuch, identische Inhalte auf verschiedenen URLs zu platzieren, um das Ranking zu manipulieren. Google sieht, dass der Canonical-Tag (wenn dein WordPress korrekt konfiguriert ist, was bei den meisten Themes und SEO-Plugins der Fall ist) immer auf die Original-Beitrags-URL verweist.

Wann es sinnvoll ist (und wann nicht):

Sinnvoll, um die Auffindbarkeit zu verbessern und die Navigation zu strukturieren:

- Verbesserte Navigation: Besucher können über verschiedene Wege (Kategorien) zu deinem Beitrag gelangen. Wenn ein Beitrag thematisch wirklich in mehrere Bereiche passt, erleichtert das die Navigation.

- Breitere Zielgruppe: Wenn dein Beitrag mehrere Aspekte abdeckt, die für unterschiedliche Interessengruppen relevant sind, kannst du sie über die entsprechenden Kategorien ansprechen.

- SEO-Potenzial (indirekt): Eine gute interne Verlinkung und Struktur kann sich positiv auf die SEO auswirken, da es Google hilft, die Relevanz deines Beitrags für verschiedene Themen zu verstehen.

Potenzielle (kleine) „Probleme“ – aber keine Duplicate Content Strafen:

- Verwässerung der Kategorie-Relevanz: Wenn du zu viele Kategorien einem Beitrag zuordnest, die nur lose passen, kann es die Relevanz der Kategoriearchivseite verwässern. Eine Kategorie sollte eine klare thematische Einheit bilden.

- „Kategorien-Spam“: Das willkürliche Zuordnen von sehr vielen Kategorien zu jedem Beitrag ist selten hilfreich und kann die Struktur unübersichtlich machen. Bleibe relevant.

- Verwirrung für den Nutzer: Wenn der Nutzer nicht klar erkennen kann, warum ein Beitrag in einer bestimmten Kategorie ist, kann das verwirrend wirken.

Beste Praxis:

- Wähle die relevanteste Hauptkategorie: Versuche immer, eine Hauptkategorie zu identifizieren, die den Kern deines Beitrags am besten beschreibt.

- Nutze Zusatzkategorien sparsam und gezielt: Füge nur weitere Kategorien hinzu, wenn der Beitrag wirklich thematisch stark in diese Bereiche passt und es die Navigation für deine Nutzer sinnvoll verbessert.

- Tags nicht vergessen: Für feinere thematische Unterteilungen und spezifische Keywords sind Tags oft besser geeignet als übermäßige Kategorien. Kategorien sind breiter gefasst, Tags spezifischer.

- Canonical URLs: Stelle sicher, dass dein WordPress Theme oder dein SEO-Plugin (wie Yoast SEO oder Rank Math) die Canonical URLs korrekt setzt. Diese weisen Suchmaschinen an, welche Version eines Inhalts die „Original“-Version ist. WordPress macht das bei Beiträgen standardmäßig.

Wie prüfe ich in RankMath, ob der Canonical URL richtig gesetzt ist?

Rank Math macht es in der Regel sehr einfach, den Canonical Link zu prüfen und gegebenenfalls anzupassen. Hier sind die wichtigsten Wege, um das zu tun:

1. Im WordPress Editor (Beitrag/Seite bearbeiten)

Dies ist der häufigste und direkteste Weg, um den Canonical Tag für einen spezifischen Beitrag oder eine Seite zu prüfen und zu ändern.

- Öffne den Beitrag/die Seite: Gehe in deinem WordPress Dashboard zu „Beiträge“ oder „Seiten“ und öffne den gewünschten Beitrag oder die Seite zum Bearbeiten (im Block-Editor oder klassischen Editor).

- Öffne die Rank Math SEO-Einstellungen: Scrolle nach unten zum Rank Math SEO-Meta-Box unterhalb des Inhaltseditors (oder klicke auf das Rank Math Icon in der oberen rechten Ecke, wenn du den Block-Editor nutzt und die Seitenleiste geöffnet ist).

- Wechsle zum „Erweitert“ (Advanced) Tab: Innerhalb der Rank Math Einstellungen findest du verschiedene Tabs (General, Advanced, Schema, Social etc.). Klicke auf den Tab „Erweitert“ (oder „Advanced“).

- Prüfe das Feld „Kanonische URL“ (Canonical URL): Dort findest du ein Feld namens „Kanonische URL“ oder „Canonical URL“.

- Standardverhalten: Standardmäßig setzt Rank Math hier die URL des aktuellen Beitrags oder der Seite als selbst-referenzierende Canonical URL. Das ist in den meisten Fällen korrekt und gewünscht.

- Manuelle Änderung: Wenn du aus irgendeinem Grund eine andere URL als kanonisch festlegen möchtest (was selten der Fall sein sollte und nur bei bewusstem Umgang mit Duplikaten nötig ist), kannst du diese hier manuell eingeben.

- Speichern/Aktualisieren: Stelle sicher, dass du den Beitrag oder die Seite aktualisierst, nachdem du Änderungen vorgenommen hast.

Wichtiger Hinweis: Wenn du den „Erweitert“-Tab nicht siehst, musst du eventuell den „Erweiterten Modus“ in den Rank Math Einstellungen aktivieren: WordPress Dashboard → Rank Math SEO → Dashboard und dort den „Erweiterten Modus“ einschalten.

2. Im Quellcode der Seite prüfen

Dies ist die zuverlässigste Methode, um zu sehen, was Google tatsächlich sieht.

- Öffne die Live-Seite: Gehe zu der betreffenden Seite auf deiner Website (nicht im WordPress Editor).

- Zeige den Quellcode an:

- Rechtsklick > Seitenquelltext anzeigen (oder „Untersuchen“ und dann zum „Elements“ oder „HTML“-Tab navigieren, aber „Seitenquelltext anzeigen“ ist einfacher).

- Tastenkombination:

Strg + U(Windows) oderCmd + Option + U(macOS).

- Suche nach dem Canonical Tag: Im Quellcode suche nach dem Tag, das so aussieht:

<link rel="canonical" href="https://deine-domain.de/dein-beitrag/" />Der

href-Wert sollte die URL sein, die du als kanonisch definiert hast oder die Rank Math standardmäßig generiert hat.

3. Mit Online-SEO-Tools

Es gibt zahlreiche kostenlose Online-Tools, die schnell den Canonical Tag einer URL überprüfen können:

- Google Search Console (URL-Prüftool): Das ist die ultimative Quelle, da sie dir direkt anzeigt, wie Google deine Seite sieht und welche URL es als kanonisch ausgewählt hat.

- Melde dich in der Google Search Console an.

- Gib die URL des Beitrags/der Seite in die Suchleiste oben ein.

- Im Ergebnisbericht unter „Seitenindexierung“ (Page indexing) findest du den Abschnitt „Von Google ausgewählte kanonische URL“ (Google-selected canonical). Dies ist die wichtigste Information. Es gibt auch „Vom Nutzer angegebene kanonische URL“ (User-declared canonical), die angibt, was Rank Math oder du gesetzt hast. Im Idealfall stimmen beide überein.

- Spezielle Canonical Tag Checker Tools: Es gibt viele Websites, die einen schnellen Check anbieten, z.B. SEOptimer Canonical Tag Checker, Sitechecker Canonical Tag Checker, oder SEOTesting Canonical Tag Checker. Du gibst einfach die URL ein, und sie zeigen dir den Canonical Tag an.

- Browser-Erweiterungen: Viele SEO-Browser-Erweiterungen (z.B. SEO Minion, Ahrefs SEO Toolbar, SEMrush SEO Toolbar) zeigen den Canonical Tag direkt an, wenn du eine Seite besuchst.

Fazit:

Du musst dir keine Sorgen um Duplicate Content machen, wenn du einem Beitrag drei Kategorien zuweist. Es ist eine Standardfunktion von WordPress zur Organisation von Inhalten und wird von Suchmaschinen verstanden. Wichtig ist, dass die Zuordnung thematisch sinnvoll und für den Nutzer nachvollziehbar ist, um eine klare und hilfreiche Navigationsstruktur auf deiner Website zu gewährleisten.

Um zu prüfen, ob der Canonical Link korrekt gesetzt ist, solltest du immer zuerst den Quellcode der Live-Seite überprüfen. Für eine schnellere Überprüfung während des Arbeitens ist das Feld in den Rank Math Einstellungen hilfreich. Um zu sehen, wie Google es wirklich interpretiert, ist die Google Search Console das mächtigste Werkzeug.

Kennst du das?

Du nutzt Microsoft To Do, hast Dutzende Aufgaben, und trotzdem fühlt sich alles an wie ein offenes Baustellenfeld ohne Fokus? So ging’s mir auch – bis wir – GEMINI & I – Jira gezähmt haben.

Ich wollte: Ideen sammeln, drei Aufgaben täglich priorisieren, eine davon erledigen – nicht mehr, nicht weniger.

Aber einfach ist bei Jira bekanntlich selten einfach…

Ein Advisor, im Deutschen oft als Berater bezeichnet, ist eine Person oder Organisation, die Fachwissen, Einblicke und Anleitungen in einem spezifischen Bereich bietet. Dies kann ein breites Spektrum von Fachgebieten umfassen, wie Finanzen, Bildung, Technologie, Recht oder Unternehmensführung. Die Rolle eines Advisors besteht darin, Klienten oder Organisationen dabei zu unterstützen, informierte Entscheidungen zu treffen, Strategien zu entwickeln oder Probleme zu lösen. Advisors nutzen ihre Erfahrung und ihr Wissen, um ihren Klienten maßgeschneiderte Ratschläge und Empfehlungen zu geben, basierend auf den spezifischen Bedürfnissen und Zielen des Klienten. (Quelle: ChatGPT: „Was ist ein Advisor?“

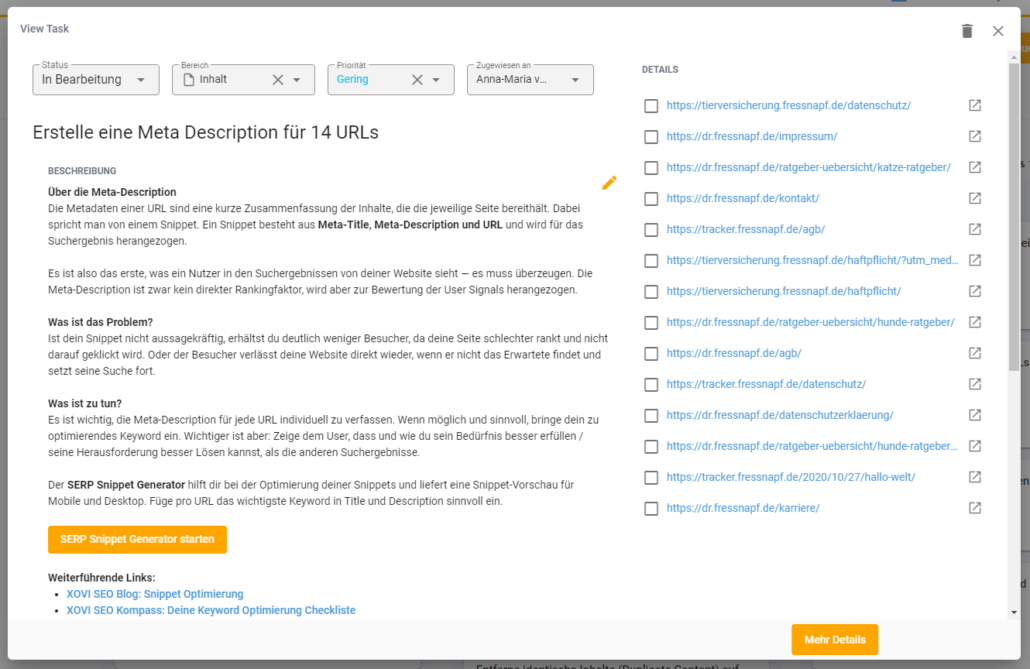

Der XOVI Advisor ist ein intelligenter SEO-Berater: Er liefert maßgeschneiderte Aufgaben und verrät, um welche du dich zuerst kümmern solltest. Jede Aufgabe enthält Hintergrundwissen und Anleitungen, wie die Aufgabe gelöst werden kann.

Gerade für unerfahrene Suchmaschinen-Optimierer ist oftmals der Einstieg eine der größten Hürden. Welche Aufgabe ist wichtig? Welche nicht? Welche Aufgaben sind überhaupt zu erledigen? Hier setzt der XOVI Advisor an.

Zunächst wird mittels der XOVI-Werkzeuge die Website auf ihren technischen Zustand, ihre Inhalte und die SEO-Kompatibilität untersucht. Die Ergebnisse diese fundierten Website-Analyse werden in konkrete, genau auf die Website zugeschnittene Aufgaben übersetzt.

Diese Aufgaben sind ein Mix aus den wichtigen SEO-Maßnahmen und den Ergebnissen der Analyse der Website. Diese Aufgaben sind unterteilt in die Bereiche

- Basis

- Technik

- Inhalt

- Linkaufbau

- Wettbewerb

- Keywords

- Keyword Recherche

- Others

und nach Prioritäten geordnet. So wird vermieden, dass schnelle und einfache, aber nicht sehr wichtige Aufgaben zuerst erledigt werden. Jede Aufgabe enthält Problemerläuterungen und eine Anleitung zur Lösung dieser Aufgabe. Hintergrundwissen wird ebenfalls mitgeliefert. Natürlich lassen sich dieser Checkliste eigene Aufgabe hinzufügen.

Diese Checkliste wird übersichtlich ähnlich einem Kanban-Board dargestellt. Die Spalten

- Offen

- In Bearbeitung

- Erledigt

bieten ein praktisches Aufgaben-Management.

Fazit: ein unglaublich nützliches Tool, das gerade dem SEO-Unerfahrenen eine wertvolle Hilfe und Orientierung im Dschungel der notwendigen SEO-Aufgaben bietet.

Frage eine Gruppenmitglieds in der Facebook-Gruppe „WordPress-Bistro„:

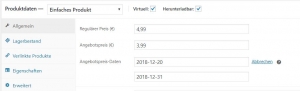

„Im in WordPress eingefügten Shopsystem Woocommerce würde ich gerne den Menüpunkt Angebote hinzufügen, wo man alle aktuelle reduzierten Artikel automatisch angezeigt bekommt. Weiss jemand, wie das geht?„

So gehts:

- Erstelle ein Produkt oder bearbeite ein bereits erstelltes Produkt: „Produkte > Erstellen“

- Vergib zusätzlich zum Produktpreis einen Angebotspreis. Du kannst diesen zeitlich beschränken, es ist optional, Du musst es nicht nutzen. (siehe Abbildung „Angebotspreis“)

- Speichere Dein Produkt

- Gehe zu Seiten > Erstellen

- Gib der Seite einen Titel, zum Beispiel „Angebote“.

- Füge in diese Seite lediglich den Text (inklusive der eckigen Klammern) [sale_products] ein. Bei dem Ausdruck handelt es sich um einen so genannten Shortcode, Du findest eine Übersicht der WooCommerce Shortcodes in der Dokumentation.

- Speichere und veröffentliche die Seite

- Gehe zu Design > Menüs

- Im Bereich Seiten wähle die soeben erstellte Seite „Angebote“

- Speichere das Menü.

- Du hast nun im Menü einen Menüpunkt „Angebote„, bei einem Klick darauf wird eine Seite mit allen derzeit im Angebot befindlichen Produkten geöffnet.

Angebotspreis

Soll die Darstellung in der Seitenleiste erfolgen, kann dafür ein Text-Widget genutzt werden. Auch dort ist lediglich der Shortcode [sale_products] einzufügen

Table of Contents

Twitter erfreut sich zunehmender Beliebtheit – diese sechs Twitter-Tipps können den Einstieg erleichtern.

(hth Horst 😉 )

Lade #Videos hoch, um mehr Interaktion zu erzielen

Verwende Videos! Tweets mit verbesserter Sichtbarkeit erhalten mehr Aufmerksamkeit. Wenn Du Videos sinnvoll – zum Beispiel zum Storytelling – nutzt, können Dir diese Tweets helfen, Aufmerksamkeit in Interesse, Interesse in Leads und Leads in Verkäufe zu verwandeln.

So geht’s: Im Browser (https://twitter.com): Klicke einfach auf das Videosymbol unter dem „Was gibt’s Neues“-Feld. Jetzt kannst Du ein Video hochladen.

In der App: Tippe auf das Symbol zum Erstellen eines Tweets unten rechts. Tippe dann auf die Aufnahmetaste, um ein Video aufzunehmen, oder lade ein Video aus dem Fotoalbum deines Geräts hoch. Du kannst auch „live gehen“ – dann twitterst Du ein Video in Echtzeit.

Bindest Du die Adresse eines (zum Beispiel Youtube)-Videos ein, so wird automatisch das Vorschaubild erstellt und die Kurzbeschreibung hinzugefügt. So kannst Du Deine Follower gezielt zu Deinem Youtube-Account führen.

Lade bis zu 4 #Fotos für jeden Tweet hoch

Wusstest du, dass du für jeden Tweet bis zu 4 Fotos hochladen kannst? Nicht nur das, Du kannst bis zu 10 Leute markieren („taggen“) und hast immer noch 140 Zeichen für die Nachricht übrig

Sobald Du ein Foto hochgeladen hast, klickst Du einfach erneut auf das Fotosymbol, um ein anderes Foto auszuwählen. Wenn Du die mobile App von Twitter verwendest, kannst Du die Bilder auch noch ein wenig bearbeiten.

Das optimale Seitenverhältnis für Bilder beträgt 2:1, das Format sollte Querformat bei 1024px * 512 px sein

Ubrigens: Fotos funktionieren auch für Direktnachrichten!

Suche nach Twitter-#Listen

Twitter-Listen sind eine pures Gold wert, um relevante Tweets zu finden und Twitter-Nutzer anzusprechen. Unter einer Liste versteht man eine benutzerdefinierte Gruppe von Twitter Accounts. Du kannst eigene Listen erstellen oder die Listen anderer Nutzer abonnieren. Wenn du eine Listen-Timeline aufrufst, werden nur die Tweets der Accounts auf dieser Liste angezeigt. Das schafft etwas Übersichtlichkeit – besonders wenn Du Tweets mit unterschiedlichen Interessen folgst.

Leider kannst Du nicht so ohne Weiteres nach Listen suchen, doch Du kannst mit Google nach ihnen suchen. So suchst Du zum Beispiel nach Listen zum Thema Excel:

site:twitter.com inurl:lists inurl:members inurl:excel

Du kannst nun eine eigene Liste erstellen und die gefundenen Personen Deiner Liste hinzufügen. Klicke dazu auf die drei Punkten neben dem „Folgen“-Button und wähle „Den Listen hinzufügen oder daraus entfernen“ Du kannst auch die komplette gefundene Liste abonnieren.

Natürlich kannst Du auch sehen, auf welchen Listen Du dich befindest. Klicke auf deinem Tab Listen auf Mitglied von, um zu sehen, auf welchen Listen du dich befindest

Verwenden Sie spezielle Twitter-#Tastenkombinationen

Lerne die Twitter-Tastaturkürzel kennen und twittere schneller.

Logge dich auf der Twitter Homepage ein, drücke dann die „Shift“ und die „?“ Tasten auf Ihrer Tastatur gleichzeitig. Es öffnet sich eine Liste der Tatstaur-Shortcuts.

Hier ein paar, um zu beginnen:

g + i = Twitter-Listen

g + l = mit „Gefällt mir“ markierte Tweets

n = neuer Tweet

m = Direkte Nachricht

#Analysiere Deine Tweets kostenlos

Twitter Analytics bietet erstaunliche Daten wie durchschnittliche Retweets, Reichweite Ihrer Tweets, einflussreichste Inhalte, Ihr Influencer … und vieles mehr

Während Du in Deinem Twitter-Konto angemeldet bist, klicke auf Dein Profilbild rechts oben und wähle „Analytics“.

Für jeden gesendeten Tweet kann die Anzahl der Impressions, der Interaktionen und die Interaktionsrate verfolgt werden. Das Wissen über die Zielgruppe hilft Tweets relevanter auszurichten

Verwende #Hashtags

Hashtags (diese Rauten, #) dienen als Filter- und Suchbegriffe. Du kannst damit Deine Tweets taggen, damit sie in der Suche besser gefunden werden. Wenn du auf einem öffentlichen Account mit einem Hashtag twitterst, kann jeder, der nach diesem Hashtag sucht, deinen Tweet finden.

Natürlich gibt es auf Twitter noch vieles zu entdecken, es gibt Tools zur Automatisierung, Indexierung, Archivierung…

Weitere Informationsquellen sind zum Beispiel

- die offiziellen Twitter-Hilfseiten

- Literatur zu Twitter

- Besonders zu empfehlen: Twitter: Eine wahre Geschichte von Geld, Macht, Freundschaft und Verrat von Bilton, Nick

Bildquelle: Pixabay

Table of Contents

Die Aufgabe:

„Gibt es eine Möglichkeit, wie neue Benutzer zu WordPress per Excel Tabelle hinzugefügt werden können?

Hintergrund: ich habe für eine firmeninterne Seite ständig die Aufgabe, neue Mitarbeiter anzulegen, was ein bisschen nervig ist. Schöner wäre, dass das Backoffice einfach neue Mitarbeiter in eine Excel Tabelle einträgt und z.B. per Zapier die Mitarbeiter als User angelegt werden. Zapier hat dafür aber scheinbar keine Funktion. Sonst wäre mir keine Möglichkeit bekannt.“

(aus einer Facebook-Gruppe zu WordPress- und SEO-Fragen)

Der Lösungsansatz:

Sicherlich ist ein Copy & Paste aus einer Excel-Tabelle eine Möglichkeit, jedoch bieten monotone und sich häufig wiederholende Tätigkeiten eine große Anzahl möglicher Fehlerquellen – insbesondere, wenn sie manuell ausgeführt werden. Jeder Softwaretester kann ein Lied davon singen (so genannte „Testerfrustration“) und führte zur Entwicklung automatisierter Tests.

Relativ triviale Aufgaben wie das Registrieren einer großen Anzahl Usern sind ein geeigneter Testkandidat (zum Beispiel für Performancetests).

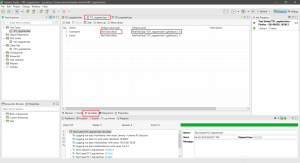

In diesem kleinen Howto nutze ich das Testautomatiserungstool „Katalon Studio“ zur Erstellung und Ausführung der Tests bzw. der Lösung o. a. Aufgabe.

Was ist Katalon Studio?

Katalon Studio ist eine kostenloses und vollständiges Automatisierungstools für Web-, Mobile- und API-Tests. Katalon Studio ermöglicht das Erstellen, Verwalten und Ausführen automatisierter Softwaretests und kann auf externe Testdaten aus Datenbanken und Tabellen zugreifen.

Eine Installation ist nicht erforderlich. Das heruntergeladene Paket wird einfach entpackt und gestartet. Das Tool ist für Windows, Mac und Linux (in einer Konsolenvariante) verfügbar. Aktuelle Version ist bei Entstehen dieses Artikels Version 5.4.2. der Download steht unter https://www.katalon.com/ zur Verfügung.

Ich hoffe mit diesem HowTo nicht nur einen möglichen Weg zur Lösung oben anstehender Aufgabe zeigen zu können, sondern auch den Einstieg in die Testautomatisierung mit Katalon Studio ein wenig zu erleichtern.

Erstellen der Lösung

Katalon Studio ermöglicht das Erstellen von Testfällen ohne Programmierkenntnisse. Das vorherigen Erlernen eine Programmiersprache ist nicht erforderlich. Ähnlich den ersten Schritten in der VBA-Programmierung wird ein Recorder genutzt, der Aktionen aufzeichnet und den zum späteren Ausführen erforderlichen Programmcode erzeugt.

Vorbereitung

Wie auch bei Videoaufzeichnungen ist das vorherige Planen des Ablaufs wichtig. Die Geschwindigkeit während der Ausführung ist unerheblich, es werden jedoch alle Fehler und Korrekturen aufgezeichnet und blähen den Code unnötig auf. Es empfiehlt sich ein „Drehbuch“ zu skizzieren und neben die Tastatur zu legen. Zeit zum Draufschauen ist immer.

Das Drehbuch entsteht „on the fly“ – wir führen alle erforderlichen Schritte aus und notieren sie. Für unsere Aufgabe sieht das Storyboard folgendermaßen aus:

- Aufrufen des URL

- Klick auf „Registrieren“-Link

- Eintragen des Benutzernamens

- Eintragen der Emailadresse

- Klick auf „Registrieren“- Button

- Prüfen, ob weitere Anwender zu registrieren sind

- JA: beginne erneut bei Schritt 2

- NEIN: gehe zu Schritt 7

- Schließen des Browsers

Da entsprechend der Aufgabenstellung Daten aus einer Excel-Tabelle eingefügt werden sollen, bereiten wir diese vor. Für Tests sollten auch nur Testdaten genutzt werden – man kann ja nie wissen 😉

Wer Schwierigkeiten hat, sich Daten einfallen zu lassen kann auf den Fake Name Generator zurückgreifen, auch Excel kann unter Nutzung von eingebauten Funktionen recht zufällige und dennoch formatgültige Daten erzeugen (die Funktionen ZUFALLSZAHL und VERKETTEN reichen dafür bereits aus).

Es ist ein recht überschaubarer Ablauf, machen wir mit unserem Testtool weiter:

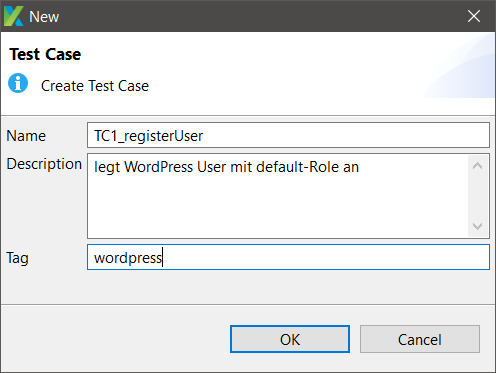

Testfall erzeugen (TC)

- Herunterladen des Paketes (das Registrieren finde ich ok, ich habe bisher ausser einer Versionsankündigung keine weiteren Mails erhalten.

- Entpacken des zip-Archivs

- Im entstandenen Verzeichnis mit einem Doppelklick auf die katalon.exe das Programm starten

- Ein neues Projekt anlegen: File > New > Projekt

- Einen neuen Testfall anlegen: File > New > Test Case

Nun ist es Zeit zum Aufzeichnen unser zuvor niedergeschriebenen Schritte.

Tipp: die URL der später aufzurufenden Seite schon mal in die Zwischenablage kopieren.

Schritte aufzeichnen

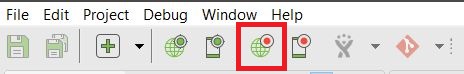

- Makro Recorder starten: Klick auf die Schaltfläche „Record Web“

- in das Feld „URL“ die aufzurufende URL hineinkopieren oder eintragen

- optional: Browser auswählen

- Aufzeichnung durch Klick auf das Browser-Symbol starten

- Es wird bereits die erste Aktion gestartet (Navigate: [„URL“]), es startet ein programmgesteuerter Browser. Beim Überstreichen der Menüpunkte und Links erscheint jeweils ein rotes Rechteck. Dies bedeutet, dass der Object Spy ein Element erkannt und bedienen kann

- Klick auf Registrieren

- Eintragen des Benutzernamens

- Eintragen einer Mailadresse

- Klick auf Registrieren

- Klick auf „Registrieren“

- Beenden des Web Recorders durch Klick auf „OK“

- den darauf folgenden Dialog „Add Element to Object Repository“ mit „OK“ bestätigen

Der erste Schritt ist getan – wir haben jetzt bereits einen ausführbaren Testfall.

Natürlich müssen auch Testfälle getestet werden. Ein Grundsatz besagt: „Teste so früh wie möglich!“, deshalb führen wir den Testfall jetzt schon einmal aus.

Da der Recorder auch die eingegebenen Daten aufgezeichnet hat löschen wir den eben erstellten Benutzer erst einmal wieder (auch diese Aktion ist ein geeigneter Kandidat für einen Testfall ‚TC2_deleteUser‘).

Erster Testlauf

Die Ausführung wird durch einen Klick auf die Schaltfläche „Run“ gestartet. Auch hier besteht wieder die Möglichkeit zur Auswahl eines Browsers.

Der Durchlauf war fehlerfrei, jedoch haben wir „vergessen“ den Schritt „Schließen des Browsers“ aufzuzeichnen. Katalon Studio ermöglicht die Erweiterung oder Änderung von Testfällen auch programmierunerfahrenen Benutzern.

Editieren des Testfalls

Klicken Sie dazu im Editorbereich des Testfalles (Register „Manual“) auf „Add“ und wählen „Web UI Keyword“. Es wird an unterster Position ein Eintrag (Item) „Accept Alert“ eingefügt, klicken Sie auf dieses Dropdownfeld und wählen „Close Browser“. Nach dem Speichern und einem nochmaligen Testlauf sollte nun auch der Browser geschlossen werden.

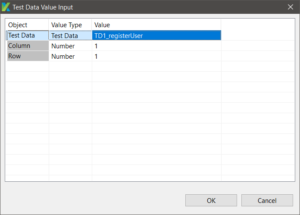

Einbinden der Testdaten (TD), Test Suite (TS) erzeugen

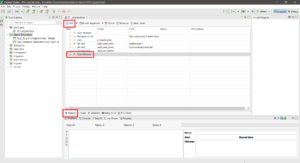

Klicken Sie auf File > New > Test Data. Im daraufhin erscheinenden Dialog lassen Sie als Data Type bitte „Excel File“ eingestellt und klicken auf „OK“. Es öffnet sich der „File’s Information“ Bereich. Unter Filename können Sie Ihre Excel-Datei auswählen, bestimmen ggf. noch das Arbeitsblatt („Sheet Name“) – das war es auch schon.

Jetzt werden die Testdaten an den Testfall gebunden. Hierzu wird eine Test Suite angelegt. Test Suites kann man sich wie Arbeitsordner vorstellen, in denen zu einem bestimmten Ereignis die betreffenden Testfälle zusammen gefasst werden können.

Zum Erzeugen einer Test Suite wählen Sie File > New – Test Suite, vergeben einen Namen und bestätigen mit „OK“. Es öffnet sich der Arbeitsbereich „Execution Information“. Klicken Sie hier auf „Show Data Binding“, dann in „Execution Information“ auf „Add“, es öffnet sich der Test Case Browser. Markieren Sie hier Ihren Testfall.

Im Bereich „Test Data“ klicken Sie ebenfalls auf „Add“, wählen „Add Before“ und im Test Data Browser Ihre Testdaten aus.

Binden der Testdaten an den Testfall

Nächster Schritt ist es nun, dem Testfall mitzuteilen, dass er statt unserer Dummy-Daten die Daten aus der Tabelle nehmen soll. Es sind also Variablen mit Werten zu füllen. Wechseln Sie auf das Register Ihres Testfalles (die Registerreiter befinden sich am oberen Rand des Arbeitsbereichs).

Am unteren Rand sehen Sie weitere Reiter, wählen Sie „Variables“. klicken auf Add und nehmen die Einstellungen entsprechend der Abbildung vor (die Felder sind jeweils nach einem Doppelklick editierbar). Die Eintragung für „Default Value“ erreichen Sie durch Doppelklick auf das Feld Value in der Zeile „Test Data“ (siehe Abbildung). Es müssen noch jeweils Zeilen- und Spaltennummer angegeben werden, dann klicken Sie auf „OK“

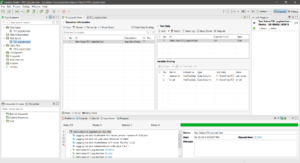

Wechseln Sie noch einmal zurück zum Register der Test Suite und klicken im Bereich „Test Data“ auf „Map All“, dann sollte die Darstellung bei Ihnen meinem abgebildeten Screenshot entsprechen.

Zurück zum Test Case: als Input-Werte stehen dort noch unsere Dummy-Werte. Wir ändern Sie per Doppelklick wie in der folgenden Abbildung gezeigt.

Nochmals alles speichern und dann ein weiterer Testlauf – et voilà! Es wurden entsprechend meiner 5 Testdatensätze 5 Benutzer registriert.

Zusammenfassung:

Automatisierte Testfälle lassen sich nicht nur zum Softwaretest verwenden, sondern auch um lästige, umfangreiche und fehlerträchtige Aufgaben zu übernehmen.

Im obigen HowTo wird der Testfall TC1_registerUser dazu verwendet, Benutzer aus einer Excel-Tabelle zu lesen und in eine WordPress-Installation einzufügen.

Verwendet wird die „Registrieren“-Funktion aus WordPress.

Folgende Schritte sind in Katalon Studio erforderlich:

- Projekt anlegen

- Testfall erzeugen

- Prozedur aufzeichnen

- Testsuite erzeugen

- Testdaten an Testfall binden

- Inputdaten gemäß Testdatenbindung im Testfall einstellen

- Testsuite ausführen

Pixabay

Pixabay